ÕƒÌZ║ÄÞ«®õØhÕÀѵÖ║Þâ¢ÕÅ»Õ┐½ÚǃÕñºÞºäµ¿íÕ©âÕ¥ÅþÜäڣǵ▒é´╝îÞç¬Õ迵£║ÕÖ¿Õ¡ªõ╣á(f¿ñn)ÕQêAutoMLÕQëÕÆî╝£×þ╗Å¥|æþ╗£µ×µ×äµÉ£þâªÕQêNASÕQîNeural Architecture SearchÕQëµêÉõ©║þø©Õ¢ôÕÅùÕê░Õà│µ│¿þÜäµû░ÚóåÕƒƒ´╝îNAS µù¿Õ£¿Õê®þö¿¢Äùµ│òÞç¬Õè¿Þ«¥Þ«íÕç║þÑ×¥lÅþ¢æ¥l£´╝îõ╝ÿþé╣µÿ»Õ┐½Úǃõ©öÚ½ÿµòêÕQîþ╝║þé╣ÕêÖµÿ»Ú£ÇÞªüÕñºÚçÅþÜäÿqÉþ«ùÞâ¢ÕèøÕQîµêɵ£¼µÿéÞ┤³cÇ?/span>

MITþö?sh¿┤)Õ¡ÉÕÀÑþ¿ïÕÆîÞ«í¢Äùµ£║┐UæÕ¡ª¥pıdè®þÉåµòÖµÄêÚƒ®µØ¥´╝굩àÕìÄÕñºÕ¡ªþö?sh¿┤)Õ¡É¥p?008¥Uº´╝ë

Ú║╚Ø£üþÉåÕÀÑÕ¡ªÚÖóÕQêMITÕQëþöÁ(sh¿┤)Õ¡ÉÕÀÑ¢EïÕÆîÞ«íþ«ùµ£║þºæÕ¡ªþ│╗Õè®þÉåµòÖµÄêÚƒ®µØ¥õ©ÄÕøóÚÿƒõØhÕæÿÞöíµÂÁÕÆîµ£▒ÕèøÞÇòÞ«¥Þ«íÕç║þÜ?NAS ¢Äùµ│òÔÇöProxylessNASÕQîÕÅ»õ╗Ñþø┤µÄÑÚÆêÕ»╣þø«µáçþí¼õ╗ÂÕÒ^ÕÅ░Þ«¡¥lâõ©ôþö¿þÜäÕì´L(f¿Ñng)º»╝£×þ╗Å¥|æþ╗£ÕQêCNNÕQë´╝îÞÇîõ©öÕ£?1000 ¥c╗ImageNet ÕñºÞºäµ¿íÕø¥Õâŵò░µì«Úøåõ©èþø┤µÄѵɣþ┤ó´╝îõ╗àÚ£Ç 200 õ©¬GPU ׫ŵùÂÕQîժ鵡ñõ¥┐Þâ¢Þ«® NAS ¢Äùµ│òÞâ¢Õñƒµø┤Õ╣┐µ│øþÜäÞó½Þ┐Éþö¿ÒÇéÞ»ÑÞ«║µûç׫åÕ£¿ 5 µ£êõïDÕè×þÜä ICLRÕQêInternationalConference on Learning RepresentationsÕQëÕñºõ╝?x¿¼)õ©èÕÅæÞí¿ÒÇ?/span>

AutoMLµÿ»þö¿õ╗ѵ¿íÕ×ïÚÇëµï®ÒÇüµêûµÿ»ÞÂàÕÅéµò░õ╝ÿÕîûþÜäÞç¬Õè¿ÕîûµûÊÄ(gu¿®)│òÕQîÞÇ?NAS Õ▒×õ║Ä AutoML µªéÕ┐Áõ©ïþÜäõ©Çõ©¬ÚóåÕƒƒ´╝î¢ÄÇÕìòµØÑÞ»▀_(d¿ó)╝î׫▒µÿ»þö¿ÔÇ£þÑ×¥lÅþ¢æ¥l£µØÑÞ«¥Þ«í╝£×þ╗Å¥|æþ╗£ÔÇØ´╝îõ©ÇµØÑÕÑ¢Õñäµÿ»ÕÅ»õ╗ÑÕèáÚǃµ¿íÕ×ïÕ╝ÇÕÅæþÜäÿqøÕ║ªÕQîÕåìÞÇà´╝îNAS Õ╝ÇÕÅæþÜä╝£×þ╗Å¥|æþ╗£ÕÅ»µ£øµ»öõØh¥cıdÀÑ¢EïÕ©êÞ«¥Þ«íþÜäþ│╗¥lƒµø┤ÕèáÕçå╝ï«ÕÆîÚ½ÿµòêÕQîÕøᵡ?AutoML ÕÆ?NAS µÿ»Þ¥¥µê?AI µÖ«ÕÅèÕîûÞ┐£µÖ»þÜäÚçìÞªüµûÊÄ(gu¿®)│òõ╣ïõ©ÇÒÇ?/span>

DeepTechÚççÞ«┐õ║åÚƒ®µØ¥´╝îõ╗ûÞí¿¢C║´╝îAutoMLµÿ»õ©¬Õ¥êµ£ëÕëìµÖ»þÜäµû╣ÕÉæ´╝îµ×µ×äµÉ£þâªÕŬµÿ» AutoML þÜäõ©ÇÚâ¿ÕêåÕQîÕ«âÞâ¢Þç¬Õè¿ÕîûÕ£░µë¥Õê¯C©Çõ║øÞ┐çÕÄÍMØh¥c└LÄóþ┤óõ©ìÕê░þÜä¥lôµ×äÕQîÕÅìÿqçµØÑÕ©«Õè®õ║ÌZ╗¼Þ«¥Þ«íÚ½ÿµòêþÜ䵿íÕ×ïÒÇéþäÂÞÇî´╝îÿqçÕÄ╗ NAS ¢Äùµ│òþÜäþí¼õ╗µòêþÄçµ£ëÕ¥àµÅÉÚ½ÿ´╝Ü(x¿¼)µÉ£þâªÿqçþ¿ïÚ£ÇÞªüÕ¥êõ╣àþÜäµùëÖù┤ÒÇüÞÇîõ©öµÉ£Õç║þÜ䵿íÕ×ïþÜäµÄ¿þÉåÚǃÕ║ªÚÜ¥õ╗Ñõ┐ØÞ»üÒÇéNAS ÕÆîþí¼õ╗Âþ╗ôÕÉê´╝îÞâ¢Õ©ªµØÑÕ¥êÕñܵû░þÜäÞ«¥Þ«íþ¡ûþòÑÒÇ?/span>

ProxylessNASõ©║þí¼õ╗ÂÕ«ÜÕêÂõ©ôÕ▒×þÜäÚ½ÿµòê╝£×þ╗Å¥|æþ╗£µ×µ×äÕQîõ©ìÕÉîþí¼õ╗ëÖÇéÕÉêõ©ìÕÉîþÜ䵿íÕ×?/span>

ÕñºÕ╣àÕçÅÕ░æÞ«íþ«ùµêɵ£¼

õ©¥õ¥ïµØÑÞ»┤ÕQîÞ░Àµ¡îµëÇÕ╝ÇÕÅæþÜäNAS ¢Äùµ│òÕQîÚ£ÇÞªüÞ┐ÉÞíîÕ£¿ GPU õ©?4.8 õ©çõ©¬×«ÅµùÂÕQîµëìÞâ¢þöƒµêÉõ©Çõ©¬þö¿µØÑÕüÜÕøæÍâÅÕêåþ▒╗µêûµúÇï╣ïõôQÕèíþÜä CNNÒÇéÕ¢ôþäË×╝îÞ░õh¡îµïѵ£ëÕ║×ÕñºþÜ?GPU µò░ÚçÅÕÆîÕàÂõ╗ûõ©ôþö¿þí¼õ╗ÂþÜäÞÁäµ║ÉÕQîÞ┐ÖÕ»╣Þ«©ÕñÜÕàÂõ╗ûõØhµØÑÞ»┤µÿ»ÚüÑõ©ìÕÅ»ÕÅèþÜäµûÊÄ(gu¿®)│òÒÇéÞÇîÞ┐Ö׫▒µÿ» MIT þáöþ®Âõ║║ÕæÿÕ©îµ£øÞºúÕå│ NAS Þ«íþ«ùµÿéÞ┤ÁþÜäÚù«ÚóÿÒÇéõ╗ûõ╗¼µÅÉÕç║þÜä ProxylessNAS ¢Äùµ│òÕQîõ╗àÚ£Ç 200 õ©?GPU ׫ŵùÂÕQîÕ░▒ÕÅ»õ╗ÑÕ£?1000 ¥c╗ImageNet þÜäÕñºÞºäµ¿íÕøæÍâŵò░µì«Úøåõ©èþø┤µÄÑÿqøÞíîµÉ£þâªÕQîµìó¢Äùõ©ïµØÑ´╝îµ»öÞ░Àµ¡îþÜä 48,000 GPU ׫ŵùÂÕQîÕ┐½õ║?240 ÕÇìÒÇéÞÇîõ©öÕQîProxylessNAS ÕÅ»õ╗ÑÚÆêÕ»╣þë╣Õ«ÜþÜäþø«µáçþí¼õ╗ÂÕÒ^ÕůC©èÕ«ÜÕêÂõ©ôÕ▒×þÜäµÀ▒Õ║ªÕ¡ªõ╣?f¿ñn)µ¿íÕ×ï´╝îõ¢┐ÕàÂõ©ìõ╗àÕçåÞÇîõ©öÿqÉÞíîÚǃÕ║ªÕ┐½ÒÇ?/span>

ÔÇ£õ©╗Þªüþø«µáçµÿ»Õ«×þÄ░õ║║ÕÀѵְÖâ¢Õ£¿ÕÉä┐Uìþí¼õ╗ÂÕÒ^ÕůC©èþÜäµÖ«ÕÅè´╝îÕ£¿þë╣Õ«Üþí¼õ╗Âõ©èµÅÉõ¥øÔÇ£õ©ÇÚö«ÕèáÚǃÔÇØþÜäÞºúÕå│µûÊÄ(gu¿®)íêÕQîÕ©«Õè?AI õ©ôÕ«ÂÕÆîÚØ× AI õ©ôÕ«ÂÒÇüþí¼õ╗Âõ©ôÕ«ÂÕÆîÚØ×þí¼õ╗Âõ©ôիµ£ëµòêþÄçÕ£░Þ«¥Þ«íÕÅêÕçåÕÅêÕ┐½þÜä╝£×þ╗Å¥|æþ╗£µ×µ×äÕQîÔÇØÚƒ®µØ¥Þ»┤ÒÇéÕÉîµùË×╝îõ╗ûõ╣ƒÕ╝°Ö░âÕQîNAS ¢Äùµ│òµ░©Þ┐£õ©ìõ╝Ü(x¿¼)ÕÅûõ╗úõ║║þ▒╗ÕÀÑþ¿ïÕ©ê´╝îÔÇ£þø«þÜäµÿ»ÕçÅÞ¢╗Þ«¥Þ«íÕÆîµö╣ÿqøþÑ×¥lÅþ¢æ¥l£µ×µ×äµëÇÕ©ªµØÑþÜäÚçìÕñìµÇºÕÆî¥JüþÉÉþÜäÕÀÑõ¢£ÔÇØÒÇ?/span>

ÞÀ»Õ¥ä¥Uºõ║îÕÇ╝ÕîûÕÆîõ┐«Õë?/span>

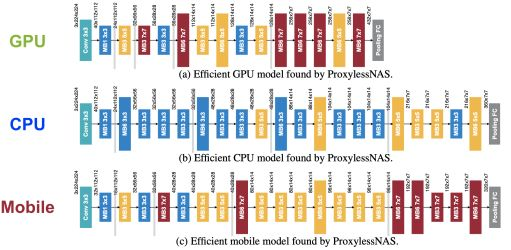

Õ£¿Þ»Ñþáöþ®Âõ©¡´╝îõ╗ûõ╗¼þÜäÕüܵ│òµÿ»ÕêáÚÖñÚØ×Õ┐àÞªüµÇºþÜä╝£×þ╗Å¥|æþ╗£Þ«¥Þ«í¥läõÜgÕQîÕǃµ¡ñ¥~®þƒ¡Þ«íþ«ùµùëÖù┤ÒÇüÕçÅ׫æÕÆîÕåàÕ¡ÿÕ╝ÇÚöǵØÑÞ┐ÉÞí?NAS ¢Äùµ│òÒÇéÕŪõ©ÇÖÕ╣Õêøµû░ÕêÖµÿ»Þ«®µ»Åõ©¬Þ¥ôÕç║þÜ?CNN Õ£¿þë╣Õ«Üþí¼õ╗ÂÕÒ^ÕůC©èÕQêCPUÒÇüGPU ÕÆîþº╗Õè¿Þ«¥Õñç´╝ëþÜäÞ┐ÉÞíîµòêþÄçµ»öõ¢┐þö¿õ╝áþ╗ƒµûÊÄ(gu¿®)│òµëÇÞ«¥Þ«íþÜ䵿íÕ×ïµØÑÕ¥ùÕ┐½ÚǃÒÇéÕ£¿ï╣ïÞ»òõ©¡´╝îþáöþ®Âõ║║ÕæÿþÜ?CNN Õ£¿µëïµ£ÌZ©èþÜäµÁïÚçÅÚǃÕ║ªÕQîµ»öþøµÇ╝╝¥_æÍ║ªþÜ?MobileNet-V2 Õ┐½õ║å 1.8 ÕÇìÒÇ?span style="color:blue">

CNN Þâ¢Þ┐×µÄÑõ©ìÕÉîÕ▒éÕQêlayerÕQëþÜäõ║║ÕÀÑ╝£×þ╗Å¥|æÞÁ\ÕQîÕÅùÕê░ÕñºÞäæÕñäþÉåÕ¬äÕâÅþÜäÞºåÞºëþÜ«Þ┤¿ÕQêvisual cortexÕQëþ╗ä¥lçÕÉ»ÕÅæ´╝îÚÇéÕÉêÕñäþÉåÞºåÞºëµûÜwØóþÜäõôQÕèí´╝îµÿ»Þ«í¢Äùµ£║ÞºåÞºëÚóåÕƒƒÕìüÕêåï╣üÞíîþÜäµ×µ×äÒÇéõ©Çõ©?CNN µ×µ×äµÿ»þö▒ÕñÜõ©¬ÕÅ»Þ░âµò┤ÕÅéµò░þÜäÞ«íþ«ùÕ▒é´╝ê┐U¯CÏô(f¿┤)ÔÇ£Þ┐çµ╗ñÕÖ¿ÔÇØ´╝ëÕQîõ╗ÑÕÅèÞ┐Öõ║øÞ┐çµ╗ñÕÖ¿õ╣ïÚù┤ÕÅ»Þâ¢þÜäÞ┐×µÄѵëÇ¥läµêÉÒÇ?/span>

ÿqÖþºìÿq×µÄѵû╣Õ╝ÅÕñÜþºìÕñܵáÀÕQîþö▒õ║ÄÕÅ»õ╗ÑÚÇëµï®þÜäµ×µ×äµò░ÚçÅ´╝ê┐U¯CÏô(f¿┤)ÔÇ£µÉ£þ┤óþ®║Úù┤ÔÇØsearch spaceÕQëÚØ×Õ©©Õ║×Õñº´╝îµëÇõ╗ѵâ│Õ║öþö¿ NAS Õ£¿µôvÚçÅÕø¥Õâŵò░µì«Úøåõ©èÕêøÕ╗ÌZ©Çõ©¬þÑ×¥lÅþ¢æ¥l£´╝îÞ«íþ«ùÚçŵÇ└Lÿ»õ©¬Õ¥êÕñºþÜäÚù«ÚóÿÕQîµëÇõ╗ÑÕÀÑ¢EïÕ©êÚÇÜÕ©©Õ£¿Þ¥â?y¿¡u)«ÅþÜäõ╗úþÉåµò░µì«Úøåõ©èÿqÉÞíî NASÕQîÕåìµèèÕ░åÞ«¡þ╗âÕÑ¢þÜä CNN ÿqüþº╗Õê░þø«µáçõôQÕèíõ©èÕQîõ¢åµÿ»´╝îÿqÖþºìµûÊÄ(gu¿®)│òÚÖìõ¢Äµ¿íÕ×ïþÜäÕçå╝﫵Ǻ´╝ñÕñûÕQîµèèõ©Çµá´L(f¿Ñng)Ü䵿íÕ×ïµ×µ×äÕÑùþö¿Õ£¿µëǵ£ëþÜä╝ï¼õÜg‗qø_Å░ÕQîõ╣ƒÚÜ¥õ╗ÑÕÅæµîÑÕÉäþºì╝ï¼õÜgþÜäµ£Çõ¢¤xòêþÄçÒÇ?/span>

þáöþ®Âõ║║Õæÿþø┤µÄÑÕ£¿ImageNet ÕñºÕ×ïµò░µì«Úøåõ©èÞ«¡þ╗âÕÆîµÁïÞ»òõ╗ûõ╗¼Õ╝ÇÕÅæþÜäµû?NAS ¢Äùµ│òÕQîÚªûÕàê´╝îõ╗ûõ╗¼ÕêøÕ¥Åõ©Çõ©¬µÉ£þ┤óþ®║Úù▀_(d¿ó)╝îÕîàÕɽõ║åµëǵ£ëÕÅ»Þâ¢þÜä CNNÔÇ£ÞÁ\Õ¥äÔÇØ´╝êÞÀ»Õ¥äµÿ»µîçÕ▒éÕÆîÿqçµÎoÕÖ¿Õªéõ¢òÞ┐×µÄѵØÑÕñäþÉåµò░µì«ÕQë´╝îÞ«?NAS ¢Äùµ│òÕÅ»õ╗ÑÞç¬þö▒Õ»└Lë¥ÕçÌZ©Çõ©¬µ£Çõ¢¤x×µ×äÒÇ?/span>

ÿqÖþºìµûÊÄ(gu¿®)│òÚÇÜÕ©©µèèµëǵ£ëÕÅ»Þâ¢þÜäÞÀ»Õ¥äÕ¡ÿÕé¿Õ£¿ÕåàÕ¡ÿõ©¡ÕQîÕªéµ×£þö¿õ╝áþ╗ƒþÜäµ×µ×äµÉ£þ┤óÕè×µ│òþø┤µÄÑÕ£¿Õìâþ▒╗ ImageNet µÉ£þâªÕQîÕ░▒õ╝?x¿¼)ÞÂàÿq?GPU ÕåàÕ¡ÿþÜäÚÖÉÕêÂÒÇéõÏô(f¿┤)õ║åÞºúÕå¤x¡ñÚù«ÚóÿÕQîþáö¢IÂõØhÕæÿÕê®þö¿õ║åõ©Ç┐Uìþº░õ©║ÔÇ£ÞÁ\Õ¥äþ±öõ║îÕÇ╝ÕîûÔÇØ´╝êpath-level binarizationÕQëþÜäµèǵ£»´╝îõ©ÇïãíÕŬգ¿ÕåàÕ¡ÿõ©¡Õ¡ÿµö¥õ©Çõ©¬Úççµá»éÁ\Õ¥ä´╝îÕñºÕ╣àÞèéþ£üÕåàÕ¡ÿþÜäµÂêÞÇùÒÇ?/span>

µÄÑþØÇÕQîõ╗ûõ╗¼Õ░åÿqÖþºìõ║îÕÇ╝Õîûõ©ÄÔÇ£ÞÁ\Õ¥äþ±öõ┐«Õë¬ÔÇØ´╝êpath-level pruningÕQëþ╗ôÕÉê´╝îÚÇÜÕ©©Þ»Ñµèǵ£»µÿ»þö¿µØÑÕ¡ªõ╣á(f¿ñn)╝£×þ╗Å¥|æþ╗£õ©¡µ£ëÕô¬õ║ø╝£×þ╗ÅÕàâ´╝êneuronÕQëÕÅ»õ╗ÑÞó½ÕêáÚÖñÕQîÞÇîõ©öõ©ìõ╝Ü(x¿¼)Õ¢▒ÕôìÞ¥ôÕç║ÒÇéõ©ìÿqç´╝îþáöþ®Âõ║║Õæÿ NAS ¢Äùµ│òµÿ»Úççþö¿õ┐«Õ묵ò┤õ©¬ÞÁ\Õ¥äõ╗ÑÕÅûõ╗úõ©óµÄë╝£×þ╗ÅÕàâ´╝îժ鵡ñÞâ¢ÕñƒÕ«îÕ࿵ö╣ÕÅÿ╝£×þ╗Å¥|æþ╗£þÜäµ×µ×äÒÇ?/span>

Õ£¿Þ«¡¥lâÞ┐ç¢Eïõ©¡ÕQîµëǵ£ëÞÁ\ե䵣ÇÕêØÚâ¢Þó½þ╗Öõ║êþø©ÕÉîþÜäÚÇëµï®µªéþÄçÕQîþäÂÕÉÄ´╝îÞ»Ñþ«ùµ│òÞÀƒÝt¬Þ┐Öõ║øÞÁ\Õ¥ä´╝î‗qÂÞ«░õ©ïÞ¥ôÕç║þÜäÕçåþí«µÇºÕÆîµìƒÕñ▒ÕQîÞ┐øÞÇîÞ░âµò┤ÞÁ\Õ¥äþÜ䵪éþÄçÕQîÕǃµ¡ñõ╝ÿÕîûÕçåþí«µÇºÕÆîµòêþÄçÒÇéµ£ÇÕÉÄ´╝îÞ»Ñþ«ùµ│òõ┐«Õ묵Äëµëǵ£ëõ¢ÄµªéþÄçþÜäÞÁ\Õ¥ä´╝îõ╗àõ┐ØþòÖµ£ÇÚ½ÿµªéþÄçþÜäÞÀ»Õ¥äÕQîÕ┼×µêɵ£Ç¥lêþëêþÜ?CNN µ×µ×äÒÇ?/span>

MITNews µèÑÚüôÚƒ®µØ¥ÕøóÚÿƒµû░þÜä╝£×þ╗Å¥|æþ╗£µ×µ×äµÉ£þ⪢Äùµ│ò

õ©║þí¼õ╗ÂÕ«ÜÕêÂþ¢æ¥l£þ╗ôµ×?/span>

ÕŪõ©ÇÖÕÜwçìÞªüÕêøµû░Õ░▒µÿ»õï╔NAS ¢Äùµ│òÔÇ£hardware-awareÔÇØ´╝îõ╣ƒÕ░▒µÿ»Þ»┤ÕQîÕ«âõ╝?x¿¼)õÏ?f¿┤)õ©Çõ©¬þí¼õ╗ÂÕÒ^ÕÅ░ÚçÅÝw½Õ«ÜÕêÂõ©ôþö¿þÜä¥|æþ╗£¥lôµ×äÕQîõï╔Õ¥ùµÄ¿þÉåþÜäÕ╗ÂÞ┐ƒµø┤õ¢ÄÒÇ?/span>

Úƒ®µØ¥ÞºúÚçèÕQîhardware-awareµÿ»µîç NAS µÉ£Õç║µØÑþÜ䵿íÕ×ïõ©ìõ╗àÕçåþí«þÄçÚ½ÿÕQîÞÇîõ©öÕ£¿þí¼õ╗ÂÕ«×ï╣ïþÜäÚǃÕ║ªõ╣ƒÞªüÕ┐½´╝îõ¢┐Õ¥ùµÉ£Õç║µØÑþÜ䵿íÕ×ïÕ«ÊÄ(gu¿®)ÿôÞÉ¢Õ£░ÒÇéþäÂÞÇî´╝îõ©ÌZ║åÚçŵÁï┐Uıdè¿Þ«æÍñçþÜ䵿íÕ×ïµÄ¿þÉåÕÜgÿqƒ´╝îÕñºÕà¼ÕÅ©þÜäõ¢£µ│òµÿ»Õê®þö¿ÕñºÚçÅþÜäµëïµ£║µØÑÕ«×ï╣ï´╝îµêɵ£¼Õ¥êÚ½ÿÕQøÞÇ?ProxylessNAS ÕêÖµÿ»¥lÖÕÜgÿqƒÕ¥Åµ¿í´╝îÿqÖµáÀÕÅ»õ╗ÑÞ«®ÕÜgÿqƒÕŻջ¹|╝êmake latencydifferentiableÕQë´╝îõ¥┐õ║ÄÕ»╣ÕÜgÿqƒÞ┐øÞíîþ½»Õê░þ½»þÜäõ╝ÿÕîû´╝îÞÇîõ©öÕŬުüõ¢┐þö¿õ©ÇÕÅ░µëïµ£║´╝îµêɵ£¼õ¢ÄÒÇüþ▓¥Õ║ªÞ»»ÕÀ«Õ░Åõ║?1 µ»½þºÆÒÇ?/span>

Õ»╣õ║Ä¥|æþ╗£õ©¡þÜäµ»Åõ©¬µëÇÚÇëÕ▒éÕQîþ«ùµ│òÕê®þö¿õ©èÿq░þÜäÕ╗ÂÞ┐ƒÚóäµÁﵿíÕ×ïµØÑÚççµá°P╝îþäÂÕÉÄõ¢┐þö¿ÿqÖõ║øõ┐íµü»Þ«¥Þ«íÕçÌZ©Çõ©¬Õ┐½ÚǃÞ┐ÉÞíîþÜäµ×µ×äÕQîÕÉîµùÂÕ«×þÄ░Ú½ÿ¥_æÍ║ªÒÇéÕ£¿Õ«×Ú¬îõ©¡´╝îþáöþ®Âõ║║ÕæÿþÜ?CNN Õ£¿þº╗Õè¿Þ«¥Õñçõ©èþÜäÞ┐ÉÞíîÚǃÕ║ªÕçáõ╣ĵÿ»þÄ░µ£?MobileNet-V2 µ¿íÕ×ïþÜ?2 ÕÇìÒÇ?/span>

Úƒ®µØ¥õ╣ƒµÅÉÕê¯C©Çõ©¬µ£ë¡æúþÜä¥lôµ×£ÕQîµ£ëõ║øÕìÀ┐U»µá©¥lôµ×äµø¥Þó½Þ»»õ╗Ñõ©║µòêþÄçÕñ¬õ¢Ä´╝îõ¢åÕ£¿þáöþ®Âõ║║ÕæÿþÜäµÁïÞ»òõ©¡ÕQîÞ┐Öõ║øµ×µ×äÕ£¿µƒÉõ║ø╝ï¼õÜgõ©èµÿ»Ú½ÿµòêþÜäÒÇ?/span>

õ╗ûµîçÕç║´╝îµ»öÕªé 7x7 ÿqÖµáÀþÜäÕñºÕì´L(f¿Ñng)º»µá©µ£ÇÿqæÕçá‗q┤Þó½µ»öÞ¥â?y¿¡u)«æÞó½õ║ÌZï╔þö¿´╝îÕøáõÏô(f¿┤) 3 õ©?3x3 Õì´L(f¿Ñng)º»µá©ÕÆî 1 õ©?7x7 Õì´L(f¿Ñng)º»µá©µ£ëÕÉîµáÀþÜäµäƒÕÅùÚçÄÕQêreceptivefieldÕQë´╝îÞÇ?3 õ©?3x3 Õì´L(f¿Ñng)º»µá©µ£ë 27 õ©¬µØâÚçì´╝î1 õ©?7x7 Õì´L(f¿Ñng)º»µá©µ£ë 49 õ©¬µØâÚçì´╝îõ╗┐õ¢ø(j¿®ng) 7x7 õ©ìÕªé 3 õ©?3x3 Þâ¢Þ«®µ¿íÕ×ïµø┤Õ░ÅÒÇ?/span>

õ¢åÕ«×ÚÖàÕ£¿ GPU õ©?invoke kernel call þÜäõ╗úõ╗ÀÕ¥êÚ½ÿ´╝îµëºÞíîÕñÜõ©¬×«ÅÕ×ïÿqçµÎoÕÖ¿õ©ìÕªéµëºÞíîÕìòõ©¬ÕñºÕ×ïÞ┐çµ╗ñÕÖ¿µòêþÄçÚ½ÿ´╝îÕñºþÜä kernel call µø┤ÚÇéÕÉê GPU ÿqÖµáÀ‗qÂÞíîÕ║ªÚ½ÿþÜäþí¼õ╗ÂÒÇéÔÇ£µëÇõ╗ÑÕ£¿ GPU õ©è´╝îProxylessNAS Õ£¿Þ¥âµÀÌqÜäÕ▒éÞç¬Õè¿ÚÇëÕÅûõ║åÕñºÚç?7x7 þÜäÕìÀ┐U»µá©ÕQîÞ┐Öµÿ»Õ¥êµ£ëµäŵÇØþÜäÕQîÔÇØõ╗ûÞ»┤ÒÇ?/span>

GPU þÜäÕãêÞíîÞ┐É¢Äùþë╣µÇºÞâ¢ÕñƒÕÉîµùÂÞ┐øÞíîÕñÜõ©¬Þ«í¢Äù´╝îÕøᵡñÕQîµëºÞíîÕìòõ©¬ÕñºÕ×ïÞ┐çµ╗ñÕÖ¿µùË×╝îÕÅìÞÇîµ»öÕñäþÉåÕñÜõ©¬×«ÅÕ×ïÿqçµÎoÕÖ¿µø┤Ú½ÿµòêÒÇéÔÇ£Þ┐Öµëôþá┤õ║åÞ┐çÕÄ╚ØÜäµâ¤x│òÔÇØ´╝îÔÇ£µÉ£þ┤óþ®║Úù┤ÞÂèÕñº´╝îÕÅ»õ╗ѵëæÍê░þÜäÕåàÕ«╣Õ░▒¡æèÕñÜÒÇéõ¢áõ©ìþƒÑÚüôµƒÉõ©¬õ©£ÞÑ┐µÿ»Õɪõ╝Ü(x¿¼)µ»öÞ┐çÕÄÍMØh¥c╚Ø╗ÅÕÄåÞí¿þÄ░Õ¥ùµø┤ÕÑ¢ÕQîÚéú׫Ìp«® AI µØѵÄóþ┤ó´╝îÔÇØÚƒ®µØ¥Þ»┤ÒÇ?/span>

õ╗ûÞ┐øõ©Çµ¡ÑµîçÕç║´╝î¥cÍM╝╝õ¥ïÕ¡ÉÕ£¿ÚçÅÕîûõ©¡õ╣ƒµ£ëõ¢ôþÄ░ÕQîÕªéõ╗ûõ╗¼µ£ÇÿqæþÜäÕÀÑõ¢£ HAQ: Hardware-aware Automated Quantization (CVPR 19 oral paper) ÕÅæþÄ░ÕQîõ©ìÕÉîþí¼õ╗Ë×╝îÕªéÞ¥╣¥~ÿÞ«¥Õñç´╝êedge deviceÕQëÕÆîõ║æþ½»Þ«æÍñçÕQêcloud deviceÕQë´╝îÕ»ÜwçÅÕîûþ¡ûþòÑþÜäÕüÅÕÑ¢µÿ»õ©ìÕÉîþÜäÒÇéõ©ìÕÉîÕ▒éÕ£¿õ©ìÕÉîþí¼õ╗Âõ©èµëÇÚ£ÇþÜäµ»öþëÊÄ(gu¿®)ò░õ╣ƒõ©ìõ©Çµá°P╝îµ£ëõ║øÕ▒éµÿ»Þ«íþ«ùÕÅùÚÖÉÕQîµ£ëõ║øÕ▒éµÿ»ÕåàÕ¡ÿÕÅùÚÖÉ´╝øÕ£¿Þ┐ÖµáÀÕñºþÜäÞ«¥Þ«íþ®║Úù▀_(d¿ó)╝îõ║║þ▒╗¥lÖµ»Å┐Uìþ¢æ¥l£ÒÇüµ»Å┐Uìþí¼õ╗ÂÞ«óÕêÂõ©ôÕ▒×þÜäÚçÅÕîû¢{ûþòÑÞ┤ÊÄ(gu¿®)ùÂÞ┤╣ÕèøÕQîÕƒ║õ║ÄÕ¡ªõ╣?f¿ñn)þÜä¢{ûþòÑÕÅ»õ╗ÑÕüÜÕ¥ùµø┤ÕÑ¢ÒÇ?/span>

õ╗ûÞ«ñõ©║´╝îÿqÖõ╣ƒÞ»┤µÿÄþáöþ®Âspecialization ÕÆ?domain-specific hardware architecture þÜäÚçìÞªüµÇºÒÇéµ£ÇÿqæÞÂèµØÑÞÂèÕñÜÕÑ¢þÜäµÀ▒Õ║ªÕ¡ªõ╣?f¿ñn)ÕÀÑõ¢£Ú⢵ÿ»þ«ùÕèøµÄ¿Õè¿þÜäÕQîµ»öÕªéþö¿õ║ÄÞç¬þäÂÞ»¡¡aÇÚóäÞ«¡¥lâþÜä BertÒÇéÕ¥êÕñÜÕ£║µÖ»ÞÉ¢Õ£¯C╣ƒÚ£ÇÞªüõ¢ÄÕèƒÞÇùþÜä╝ï¼õÜgµö»µîüÕQîµ»öÕªéþ½»õ©èµÖ║Þâ¢ÕÆî AIoTÒÇéµëÇõ╗ѵ£¬µØÑþ«ùµ│òÕÆî¢ÄùÕèøþÜäÕìÅÕÉîþáö¢Iµÿ»ÕÇ╝Õ¥ùÕà¤x│¿þÜäµû╣ÕÉæÒÇ?/span>

Õ©«Õè®õ║║þ▒╗ÕçÅÞ¢╗ÕüÜþÉÉõ║ïµêûÕÀÑõ¢£þÜäÞ┤ƒµïà´╝îõ©Çþø┤µÿ»ÕñºÕ«ÂÕ»?AI þÜäµ£ƒµ£øÒÇéÞ┐Öõ╣ƒÕ░▒µÿ»õÏô(f¿┤)õ╗Çõ╣?AutoML ÕÆ?NAS ÕÅùÕê░ÚçìÞºåþÜäÕăÕøáõ╣ïõ©ÇÕQîµëÇõ╗ÑÕªéµ×£ÞªüÞ«?NAS µÖ«ÕÅèÕQîÚÖñõ║åÕàïµ£ìõ©èÿq░þÜäÞ«íþ«ùµêɵ£¼Ú½ÿõ╣ïÕñû´╝îÿqÿµ£ëÕô¬õ║øÚ£ÇÞªüõ©Çµ¡Ñµö╣ÕûäþÜäÚù«ÚóÿÕQƒÚØóÕ»╣Þ┐Öõ©¬µÅÉÚù«´╝îÚƒ®µØ¥¥lÖõ║åõ©ñõ©¬Õ¥êµÿÄ╝ï«þÜäµû╣ÕÉæÕQîõ©Çµÿ»Þ«¥Þ«íþ®║Úù▀_(d¿ó)╝êdesign spaceÕQëþÜäÞ«¥Þ«íÕQîþø«ÕëìþÜä NAS µÇºÞâ¢ÕÑ¢ÕØÅÕ¥êÕñº¢EïÕ║ªõ¥ØÞÁûÞ«¥Þ«í¢I║Úù┤þÜäÚÇëÕÅûÕQîÞ┐ÖÚâ¿Õêåÿqÿµ£ëÕ¥êÕñÜõ║ÌZÏô(f¿┤)þÜäþ╗ÅÚ¬îÒÇéõ║îµÿ»Õ»╣ÚǃÕ║ªÕÆîÞÁäµ║ÉþÜäõ╝ÿÕîûÕQîõÏô(f¿┤)õ║åÞ«® NAS µø┤Õ«╣µÿôÕ£¿ÕÀÑõ©ÜþòîÞÉ¢Õ£Ä═╝îµ£ëõ©ñõ©¬µØíõ╗Ë×╝Ü(x¿¼)µÉ£þâªþÜäÞ┐ç¢EïÕìáþö¿þÜäÞ«íþ«ùÞÁäµ║ÉÞªüõ¢ÄÕQîµÉ£þ┤óÕç║þÜ䵿íÕ×ïþí¼õ╗µòêþÄçÞªüÚ½ÿÔÇöÔÇöµ£Ç¥lêÕ«×þÄ░Þ«®╝ï¼õÜgµòêþÄçÕÆîþ«ùµ│òµÇºÞâ¢ÕÉѵÅÉÕìçÒÇ?/span>